Tehisintellekt varastab sel viisil teie andmeid

Tehisintellekt varastab sel viisil teie andmeid

Tehisintellekt varastab sel viisil teie andmeid

Rühm Ameerika ja Šveitsi ülikoolide teadlasi avaldas koostöös Google'i ja selle tütarettevõttega DeepMind uurimistöö, milles selgitatakse, kuidas andmed võivad lekkida pildiloomeplatvormidelt, mis põhinevad oma töös generatiivsetel tehisintellekti mudelitel, nagu DALL-E, Imagen, või stabiilne difusioon.

Need kõik töötavad ühtemoodi, lähtudes sellest, et kasutaja sisestab konkreetse tekstiviipa, nt "avokaado kujuline tugitool" ja loob tekstist mõne sekundi jooksul pildi.

Nendel platvormidel kasutatavad generatiivsed AI mudelid on treenitud väga suurel hulgal etteantud kirjeldusega piltidel Idee seisneb selles, et närvivõrgud suudavad pärast tohutul hulgal treeningandmete töötlemist genereerida uusi ja unikaalseid pilte.

Uus uuring aga näitab, et need pildid ei ole alati unikaalsed.Mõnel juhul suudab närvivõrk reprodutseerida pilti, mis vastab täpselt varasemale treeningul kasutatud pildile.See tähendab, et närvivõrgud võivad kogemata paljastada privaatset infot.

See uuring seab kahtluse alla seisukohad, et piltide genereerimiseks kasutatavad AI mudelid ei salvesta oma treeningandmeid ja et treeningandmed võivad jääda privaatseks, kui neid ei avalikustata.

Esitage rohkem andmeid

Süvaõppesüsteemide tulemused võivad mittespetsialistide jaoks olla hämmastavad ja nad võivad arvata, et need on maagia, kuid tegelikult pole asjas maagiat, kuna kõik närvivõrgud lähtuvad oma töös samal põhimõttel, milleks on koolitus. kasutades suurt andmekogumit ja iga pildi täpset kirjeldust, näiteks: pildiseeriad kassidest ja koertest.

Pärast treenimist kuvab närvivõrk uue pildi ja palub otsustada, kas tegemist on kassi või koeraga. Sellest tagasihoidlikust punktist liiguvad nende mudelite arendajad edasi keerukamate stsenaariumide juurde, luues kujutise olematust lemmikloomast, kasutades algoritmi, mida on treenitud paljude kassipiltide jaoks. Neid katseid ei tehta mitte ainult piltide, vaid ka teksti, video ja isegi heliga.

Kõikide närvivõrkude lähtepunktiks on treenitav andmekogum.Närvivõrgud ei saa luua tühjalt uusi objekte. Näiteks kassi kujutise loomiseks peab algoritm uurima tuhandeid reaalseid kasside fotosid või jooniseid.

Suured jõupingutused andmekogude konfidentsiaalsena hoidmiseks

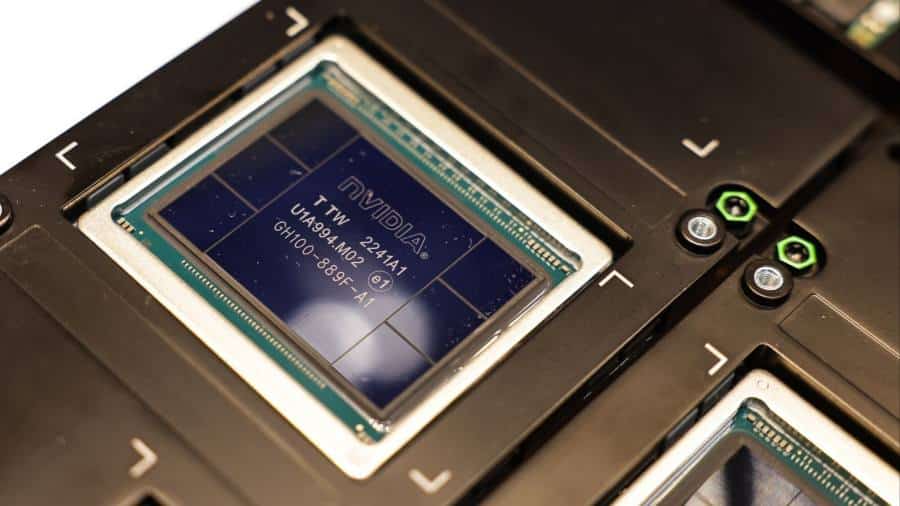

Teadlased pööravad oma artiklis erilist tähelepanu masinõppe mudelitele. Need töötavad järgmiselt: nad moonutavad koolitusandmeid – inimeste, autode, majade jne kujutisi – lisades müra. Järgmiseks koolitatakse närvivõrku taastama. need pildid algsesse olekusse.

See meetod võimaldab luua vastuvõetava kvaliteediga pilte, kuid potentsiaalne puudus – võrreldes näiteks generatiivsete konkureerivate võrkude algoritmidega – on selle suurem kalduvus andmete lekkimisele. Algandmeid saab sellest välja võtta vähemalt kolmel erineval viisil, nimelt:

Spetsiaalsete päringute kasutamine, et sundida närvivõrku väljastama konkreetset lähtepilti, mitte midagi ainulaadset, mis on loodud tuhandete piltide põhjal.

Algset pilti saab rekonstrueerida isegi siis, kui sellest on saadaval vaid osa.

On võimalik lihtsalt kindlaks teha, kas konkreetne pilt sisaldub treeningandmetes või mitte.

Sageli on närvivõrgud laisad ja uue pildi loomise asemel toodavad nad midagi treeningkomplektist, kui see sisaldab sama pildi mitut duplikaati. Kui pilti korratakse treeningkomplektis rohkem kui sada korda, on väga suur tõenäosus, et see lekib originaalilähedasel kujul.

Teadlased näitasid aga viise, kuidas hankida treeningpilte, mis algses komplektis ilmusid vaid korra. Teadlaste testitud 500 pildist lõi algoritm neist juhuslikult kolm.

Kellelt varastas?

2023. aasta jaanuaris kaebasid kolm kunstnikku tehisintellektil põhinevad kujutiste genereerimise platvormid kohtusse, kuna nad kasutasid oma veebipilte oma modellide koolitamiseks ilma autoriõigusi austamata.

Närvivõrk võib tegelikult kopeerida kunstniku stiili, jättes ta seega ilma sissetulekust. Paber märgib, et mõnel juhul võivad algoritmid erinevatel põhjustel osaleda otseses plagiaadis, genereerides jooniseid, fotosid ja muid pilte, mis on peaaegu identsed päris inimeste töödega.

Nii andsid teadlased soovitusi esialgse koolitusrühma spetsiifilisuse suurendamiseks:

1- välistage treeningrühmades kordused.

2- Töötle treeningpilte uuesti, nt lisades müra või muutes heledust; See muudab andmete lekke tõenäosuse väiksemaks.

3- Algoritmi testimine spetsiaalsete treeningpiltide abil ja seejärel kontrollimine, et see ei taasta seda tahtmatult täpselt.

mis on järgmine?

Generatiivsed kunstiplatvormid on viimasel ajal kindlasti tekitanud huvitava arutelu, mille käigus tuleb otsida tasakaalu kunstnike ja tehnoloogia arendajate vahel. Ühest küljest tuleb austada autoriõigusi ja teisest küljest, kas tehisintellekti loodud kunst erineb väga palju inimkunstist?

Aga räägime turvalisusest. Artiklis esitatakse konkreetsed faktid vaid ühe masinõppemudeli kohta. Laiendades kontseptsiooni kõigile sarnastele algoritmidele, jõuame huvitavasse olukorda. Pole raske ette kujutada stsenaariumi, kus mobiilsideoperaatori intelligentne assistent annab vastuseks kasutaja päringule üle tundlikku ettevõtteteavet või kirjutab võltsitud skripti, mis palub avalikul närvivõrgul luua kellegi passi koopia. Teadlased rõhutavad aga, et sellised probleemid jäävad esialgu teoreetiliseks.

Kuid praegu on ka muid tõelisi probleeme, kuna skriptide genereerimise mudeleid, näiteks ChatGPT-d, kasutatakse nüüd tõelise pahatahtliku koodi kirjutamiseks.

Ja GitHub Copilot aitab programmeerijatel koodi kirjutada, kasutades sisendina tohutul hulgal avatud lähtekoodiga tarkvara. Ja tööriist ei austa alati nende autorite autoriõigusi ja privaatsust, kelle kood jõuab väga laiendatud koolitusandmete hulka.

Neuraalvõrkude arenedes arenevad ka nende vastu suunatud rünnakud, mille tagajärgi keegi veel ei mõista.